Le Tegra X1 de NVIDIA roule en Audi (comme Pascal) |

————— 05 Janvier 2015 à 12h11 —— 16438 vues

Le Tegra X1 de NVIDIA roule en Audi (comme Pascal) |

————— 05 Janvier 2015 à 12h11 —— 16438 vues

Le CES 2015 c'est pour cette semaine et NVIDIA aime bien se faire mousser d'entrée de jeu. C'est pourquoi Jen-Hsun Huang son CEO attaque direct avec un live stream presse pour annoncer ses nouvelles techno. Cette année ça tourne autour du nouveau Tegra et de ses applications aussi bien sur tablette, que dans le milieu automobile. On se souviendra de l'Audi qui se conduisait toute seule lors de leur keynote l'année dernière où l'on découvrait leur futur projet nommé Pascal en l'honneur de notre bien aimé rédac' chef.

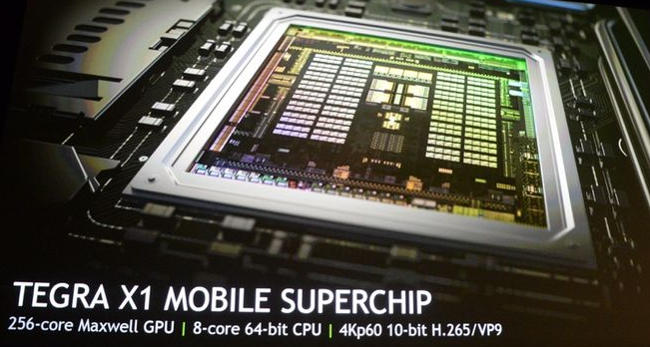

Le Tegra X1 est la première puce en 20nm du caméléon, ce SoC se compose d'un CPU 64-bit à 8 coeurs (quatre Cortex A53 et quatre Cortex A57) et d'un GPU à 256 coeurs Maxwell. Son application sera premièrement dans des tablettes et les systèmes embarqués dans le monde de l'automobile du genre du Drive CX présenté en même temps (ça tombe bien hein ?). Cette petite puce est compatible DirectX 12, capable de faire tourner des vidéos en 4K à 60Hz avec une précision des couleurs de 10-bit, est compatibles avec les formats H.265 et VP9 et arrive à faire tourner la démo de l'Unreal Engine où des élémentaires de feu et glace se mettent sur la trogne à grands coups d'Unreal Engine, tout ça avec juste 10W de TDP. On vous épargne les graphiques montrant à quel point le Tegra X1 écrase la concurrence et double les capacités du Tegra K1 et on attend de voir si des appareils équipés de ce SoC sont prévus (avec un TDP de 10W ça risque d'être compliqué dans une tablette) et surtout à quel prix. Les plus curieux peuvent retrouver la conférence complète juste en dessous.

| Un poil avant ?Intel investit 24.8M de $ dans le fabricant de lunettes connectées Vuzix | Un peu plus tard ...Un (petit) peu plus de GTX 980 Classified Kingpin |  |