La GDDR7 va galvaniser nos GPU dans les jeux vidéo, promet Micron |

————— 05 Juin 2024 à 12h34 —— 27545 vues

La GDDR7 va galvaniser nos GPU dans les jeux vidéo, promet Micron |

————— 05 Juin 2024 à 12h34 —— 27545 vues

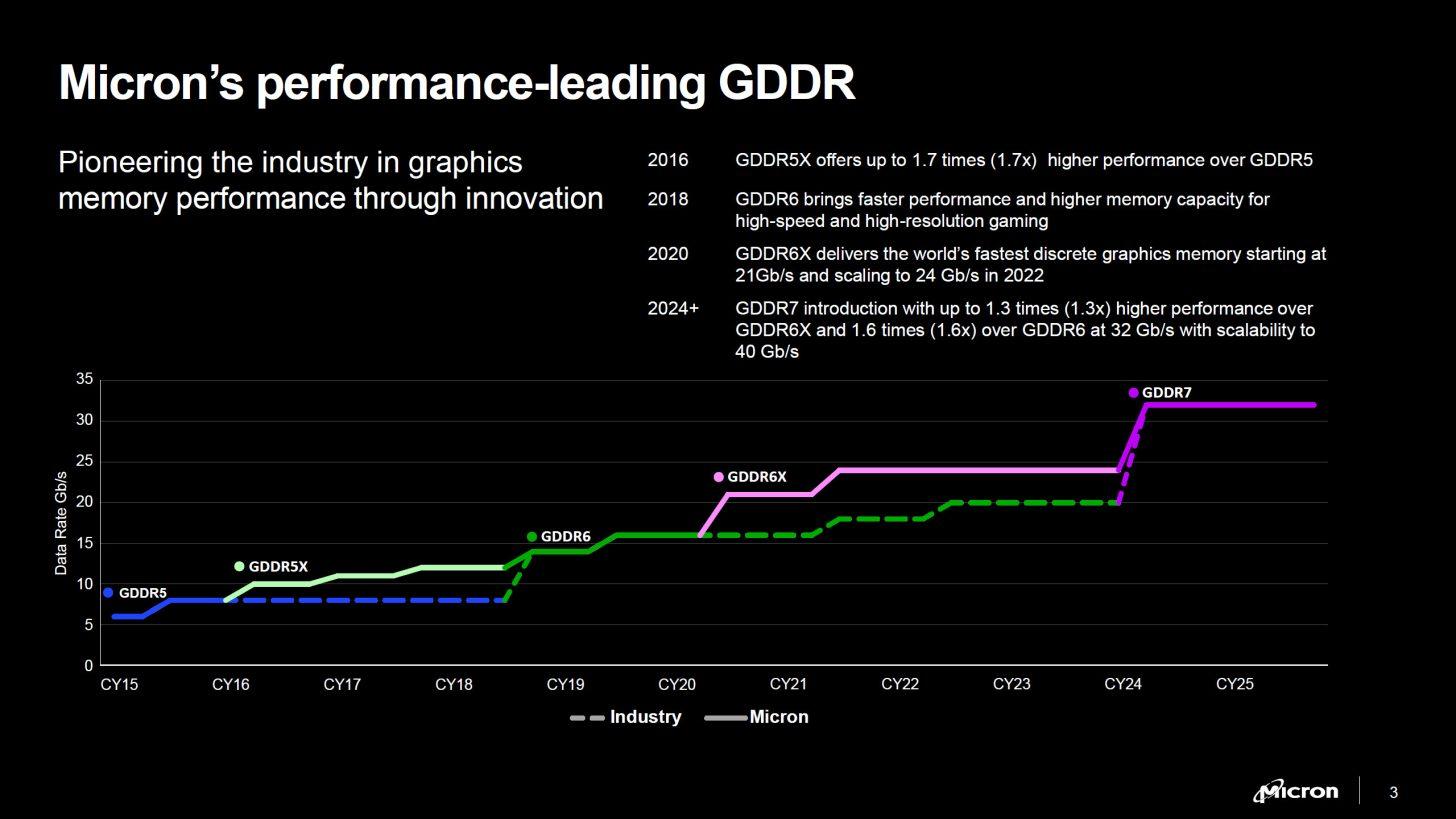

Le JEDEC a officialisé la GDDR7 en mars dernier ; Samsung et SK Hynix ont présenté des modules à la GTC 2024. Micron était en revanche plus silencieuse sur ce sujet depuis quelques semaines. L’entreprise vient finalement d’officialiser sa GDDR7 à 32 Gbit/s, avec des puces mémoire actuellement en phase d’échantillonnage.

Un joueur à l'évidence médusé par les performances de sa carte graphique dotée de GDDR7 © Micron

Cette mémoire GDDR7 de Micron exploite la technologie DRAM 1β (1-bêta). À l’instar de celles de Samsung, les premières puces plafonnent à 32 Gbit/s pour une densité de 16 Gb et une tension de 1,2 V ; la bande passante système est donnée à 1,5 To/s.

GDDR7 vs GDDR6 © Micron

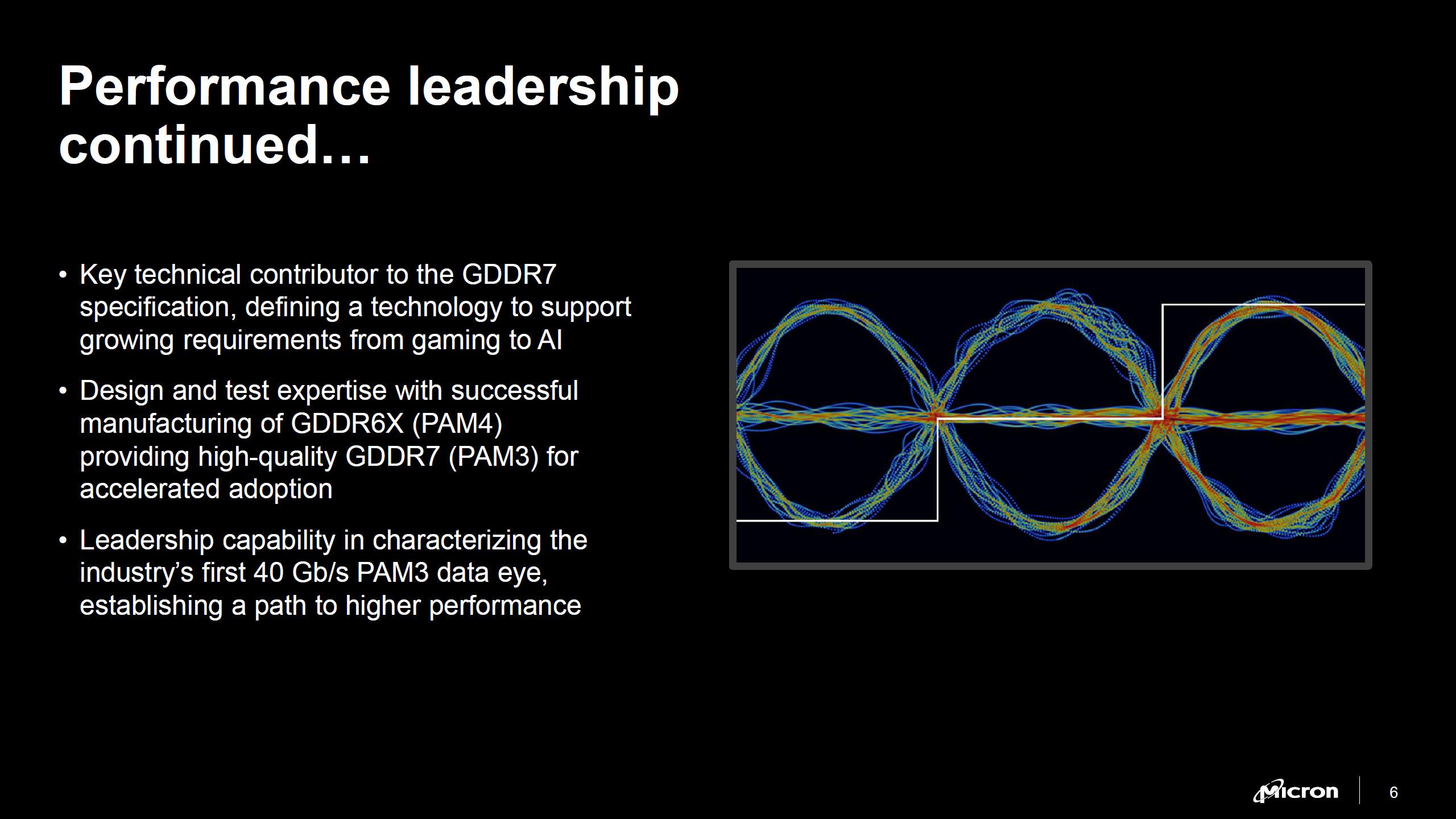

Conformément à la spécification du JEDEC, cette GDDR7 exploite logiquement le PAM-3, ou Pulse-Amplitude Modulation 3, plutôt que le NRZ, Non-Return-to-Zero, de la GGDR6 (PAM-4 pour la GDDR6X de Micron).

Pour sa GDDR7, la société évoque un rendement énergétique 50 % supérieur par rapport à la mémoire GDDR6, avec à la clef une « amélioration des performances thermiques », ainsi « qu’un nouveau mode veille permet de réduire la consommation de 70 % » dans ce statut.

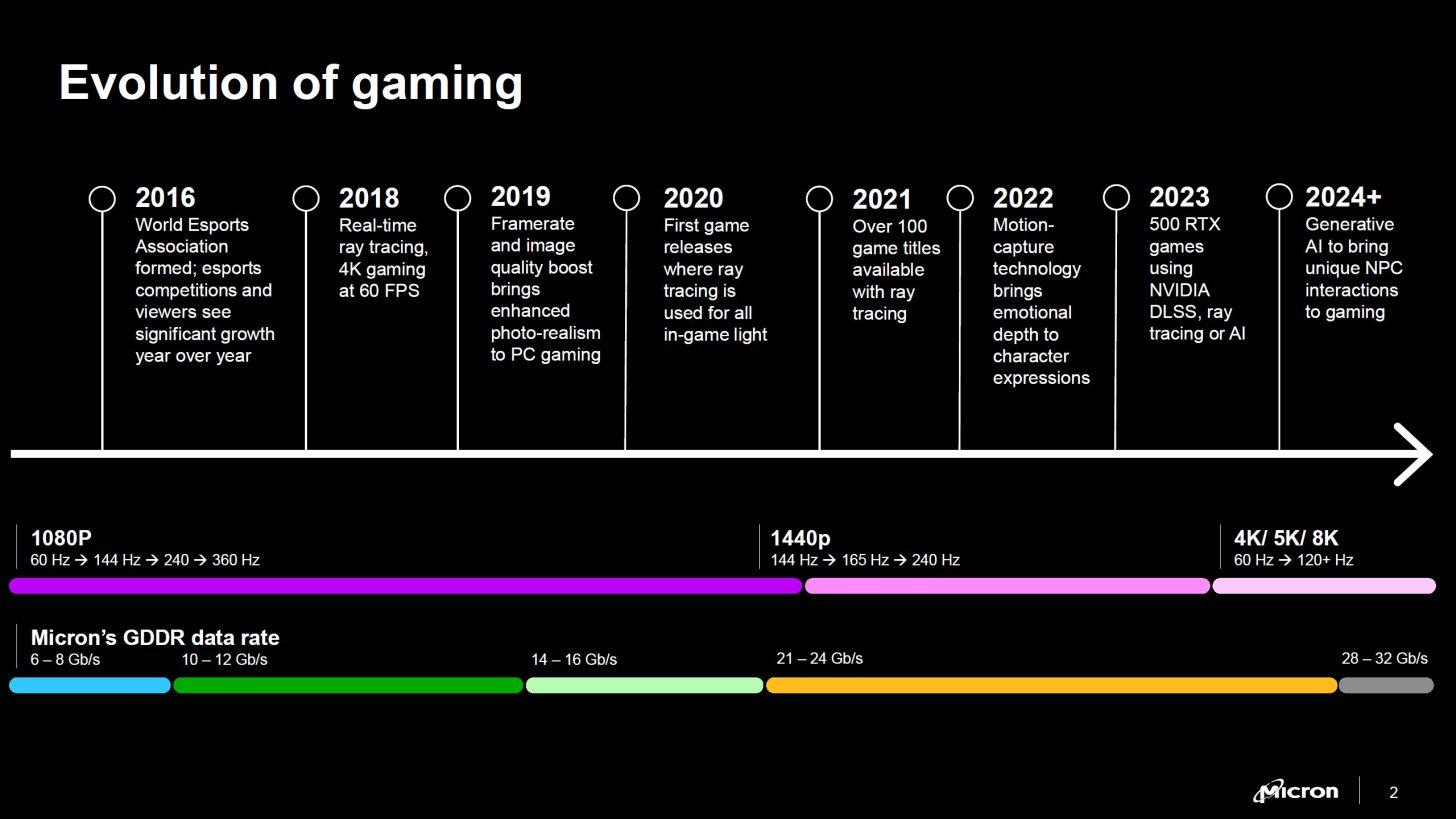

Sans surprise, Micron expose les bénéfices que va apporter la GDDR7 dans le domaine des jeux vidéo, mais également dans les charges de travail liées à l'intelligence artificielle. Avant de nous y intéresser, quelques diapositives qui retracent l'évolution de la GDDR.

L'évolution de la GDDR au fil des années ; et forcément, Micron a toujours eu une longueur d'avance © Micron

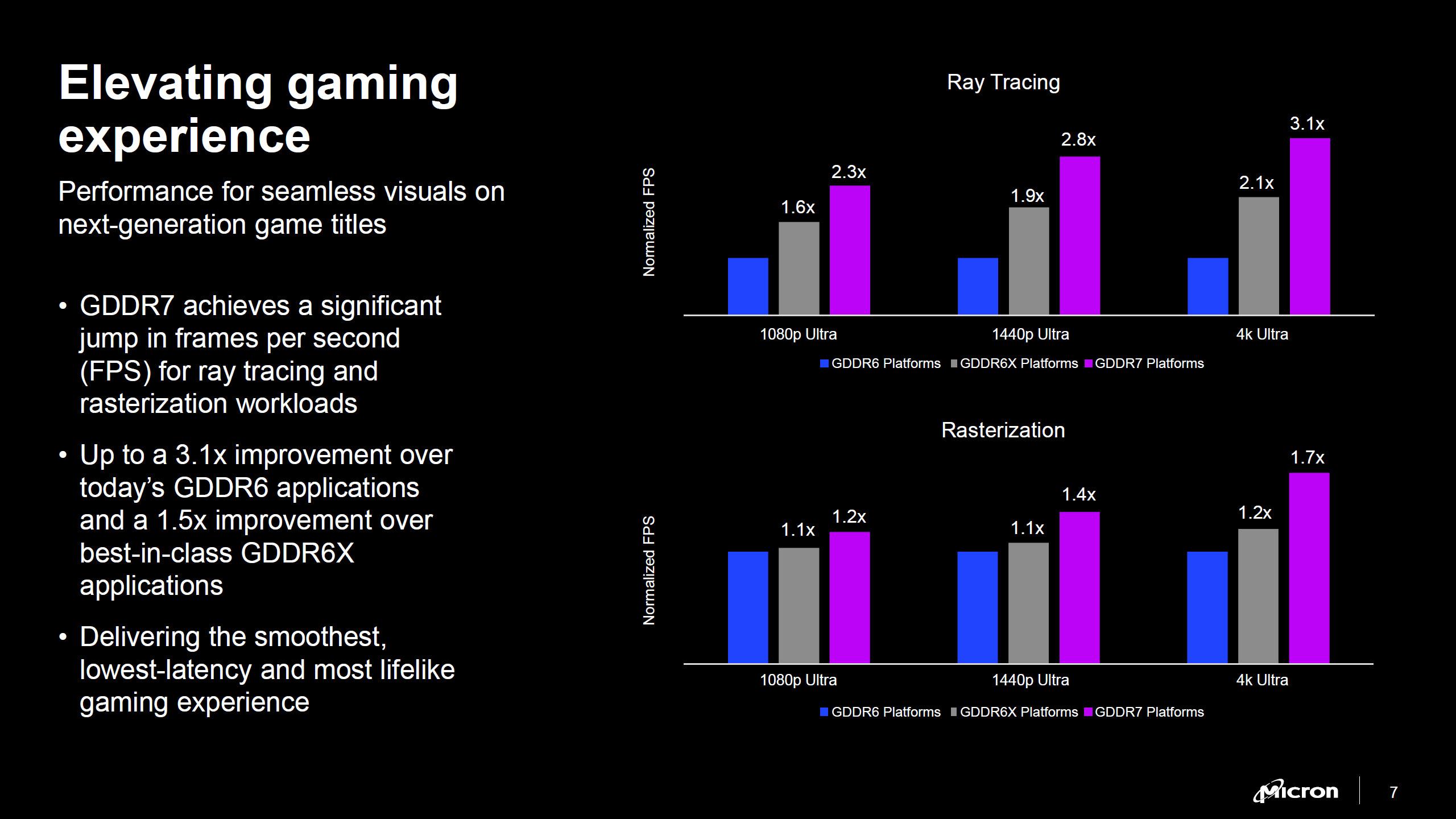

Pour le premier aspect, la société allègue que les cartes graphiques munies de GDDR7 afficheront jusqu’à 3,1 fois plus d’images par seconde que les solutions actuelles en GDDR6 dans une définition 4K en ray tracing. Les écarts sont logiquement moins élevés avec des GPU épaulés par de la GDDR6X, dans des définitions inférieures, ainsi qu'en rastérisation, mais restent conséquents. Tout ceci est bien sûr très théorique et certainement embelli ; de plus, les performances réelles dépendront aussi des capacités du GPU. Les gains octroyés par une vitesse mémoire plus rapide ne sont toutefois plus à démontrer ; citons le cas des Radeon RX 5600 XT, dont certains modèles ont une vitesse mémoire bloqué à 12 Gbit/s, d'autres à 14 Gbit/s, pour des différences d'IPS souvent notables. L'écart est en revanche moins marqué entre la RTX 3060 Ti GDDR6X et celle dotée de GDDR6, malgré une différence de vitesse mémoire plus élevée (19 Gbit/s vs 14 Gbit/s respectivement).

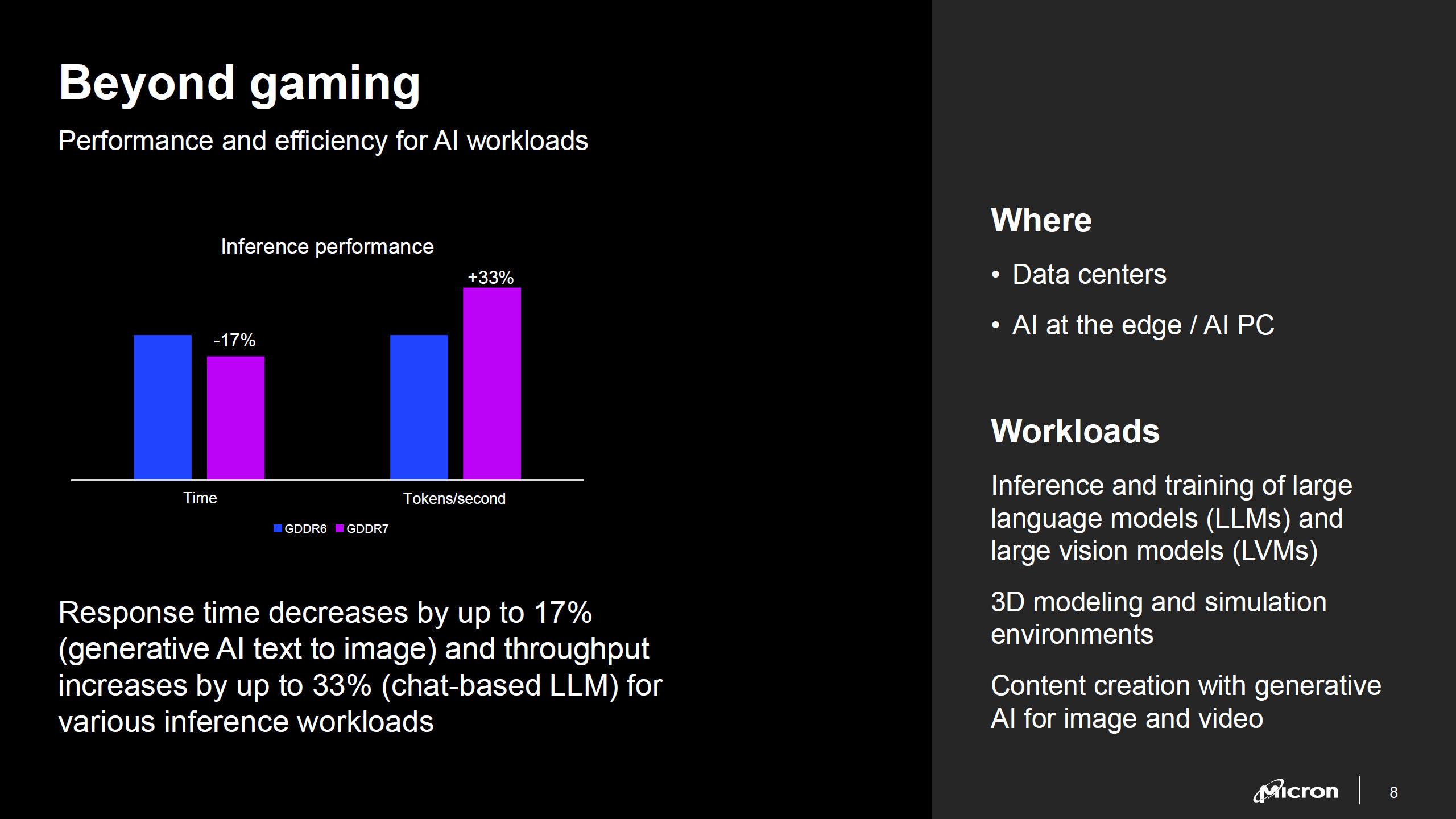

Outre le secteur du jeu vidéo, Micron vante les bienfaits de la GDDR7 sur les applications d’inférence IA. Pour cet aspect, l’entreprise évoque un temps de traitement réduit de 17 % pour les charges de travail d'IA générative du type Text To Image et un débit augmenté de 33 % pour les grands modèles de langage (LLM).

Micron accompagne son communiqué de presse de plusieurs citations. Voici celle de Joe Macri, vice-président et directeur technique produits de l'unité commerciale d'AMD : « Chez AMD, nous nous engageons à créer les expériences de jeu les plus immersives. Notre collaboration avec Micron sur la GDDR7 fait progresser notre objectif commun. Nous sommes ravis que Micron lance la GDDR7 et nous sommes impatients de tirer parti de cette technologie pour rendre les jeux encore plus réactifs et réalistes. »

En dépit de cette déclaration, les projets d’AMD pour l’intégration de la GDDR7 restent très incertains. À en croire certaines rumeurs persistantes, l’entreprise miserait sur une gamme RDNA 4 centrée sur l’entrée et le milieu de gamme ; concrètement, les Radeon RX 8000 se limiteraient à la GDDR6. Du côté de NVIDIA, l’hypothèse du passage à la GDDR7 pour les GeForce RTX 5000 haut de gamme fait davantage consensus.

Nous serons de toute façon bientôt fixés, puisque ces prochaines générations devraient voir le jour avant la fin d’année 2024 (du moins les GeForce Blackwell). Quant à la GDDR7 de Micron, la société précise qu’elle « sera disponible directement auprès [d'elle] et par l'intermédiaire de certains distributeurs et revendeurs mondiaux au cours du second semestre de l'année civile 2024 ».