Google peut améliorer la qualité d'une image grâce au "Machine Learning" |

————— 28 Novembre 2016 à 15h30 —— 20655 vues

Google peut améliorer la qualité d'une image grâce au "Machine Learning" |

————— 28 Novembre 2016 à 15h30 —— 20655 vues

Vous avez tous au moins vu une fois un film ou une série où un "expert" prend une image en extra basse définition, prise par une caméra de secteur de nuit avec un éclairage pourri, et arrive à en tirer le visage d'un prétendu voleur de poule en haute définition et en un clin d'oeil, permettant ainsi son arrestation. C'est l'une des blagues les plus risibles du cinéma et pourtant, Google a mis au point une technologie permettant cette prouesse grâce à l'apprentissage statistique dont sont capables nos machines ("Machine Learning" pour les anglophones).

Cette technologie, ils l'ont appelée RAISR (Rapid and Accurate Image Super-Resolution) qui permet de reconstruire les données manquantes d'une image de mauvaise qualité. Comme vous le savez certainement, tout ce qui s'affiche sur votre moniteur est sur base de petits points nommés pixels. À l'heure de l'UHD, tout le monde a compris que plus il y en a et mieux c'est, une haute définition permettant plus de précisions. Dans le cas d'une image de mauvaise qualité que l'on essaierait d'agrandir, il manquera des informations et on aura le droit à un crénelage du plus mauvais goût. Grâce à RAISR, la machine va être capable de déterminer quelle suite donner à une série de pixels pour s'approcher du suivant réellement présent sur l'image.

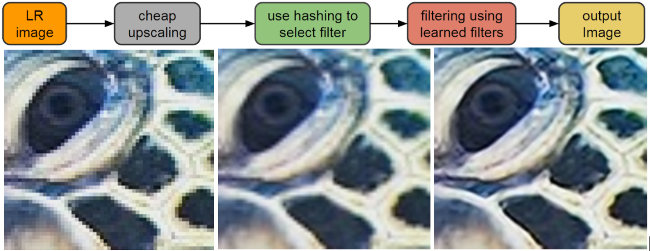

À gauche l'image originale, au centre un agrandissement par deux et à droite l'utilisation de RAISR

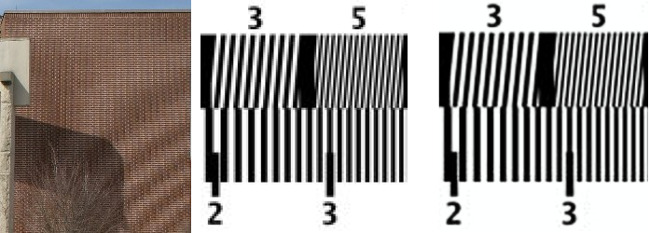

Les techniques d'agrandissement d'image existent déjà (on parle d'Upsampling dans ce milieu), mais se servent généralement des pixels présents sur l'image en les copiant pour reconstruire les endroits manquants, ce qui est de l'interpolation et parlera à ceux qui aiment avoir beaucoup de FPS en jeu. Sur l'image présentée précédemment, vous avez l'original à gauche, un agrandissement par deux au centre et à droite la solution de Google. Même un oeil peu averti saura faire la différence et l'option de Google va plus loin en permettant la chose beaucoup plus rapidement et sur du matériel standard (comprenez votre PC ou même une bonne tablette). De plus, elle arrive à régler le problème de crénelage (aliasing) qui pose problème sur les agrandissements standards. En effet, une méthode d'amélioration linéaire de l'image va forcément reproduire une partie des défauts de cette dernière, avec RAISR, l'image en basse définition servant de base pour que la machine devine ce qu'il y a dans les trous, cela permet de compenser la chose et d'éviter de reproduire ce qui ne devrait pas l'être. Plus parlant que des mots, voici une image présentant la chose :

À gauche le problème de crénelage dans l'agrandissement linéaire, au centre une image de base, à droite la même traitée par RAISR

Avec RAISR, Google estime que n'importe quel appareil pourrait arriver à augmenter la qualité d'une image. L'application d'une telle technologie sera un grand plus pour l'industrie de l'image et plaira certainement au grand public au passage. Tout le monde a sur sa machine des images prises il y a quelques années, quand les capteurs numériques n'étaient pas au point où que les moniteurs se contentaient encore d'un fier 1024x768 et RAISR pourrait alors redonner un coup de jeune à ce qui a rapidement vieilli. Dans tous les cas, Hollywood pourra enfin se vanter d'avoir vu l'avenir en présentant des équipes informatiques capables de réaliser cette prouesse plusieurs années avant que la chose soit possible. (source : TechPowerUp)

| Un poil avant ?Le sac à dos VR GO de ZOTAC devient réalité | Un peu plus tard ...Les GeForce 376.09 WHQL sont là pour les possesseurs de GTX qui aiment les chiens |  |