Intel Architecture Day • Sunny Cove contre-attaque |

• 12 Décembre 2018

Intel Architecture Day • Sunny Cove contre-attaque |

• 12 Décembre 2018

Autant au niveau du serveur que de la mémoire, peu de choses sont nouvelles. On savait déjà que les variantes 2, 3 et L1TF de Spectre étaient corrigées au niveau hardware, mais un rappel ne fait pas de mal. Les instructions VNNI (Virtual Neural Network Instructions) pour le machine learning, basées sur les unités de calcul gérant l'AVX-512, ont néanmoins nécessité un certain degré d'implémentation matérielle. Il ne s'agit donc pas d'un simple convertisseur vers des micro-opérations par le microcode pour faire illusion, comme on aurait pu le redouter au premier abord. Notez que le marketing a également renommé l'utilisation de ces instructions en DL Boost, c'est effectivement plus simple pour frapper les esprits. De plus, la partie contrôleur mémoire a dû être revue afin de pouvoir accueillir les barrettes Optanes nommées Optane DC (support de 12 canaux maximum), fonctionnalité restant pour le moment cloisonnée aux Pro, exit donc le To de RAM sur une plateforme HEDT à l'heure actuelle. Pour le reste, le 14nm ++ est de la partie, avec un maximum de 48 cœurs, circulez c'est tout pour le moment !

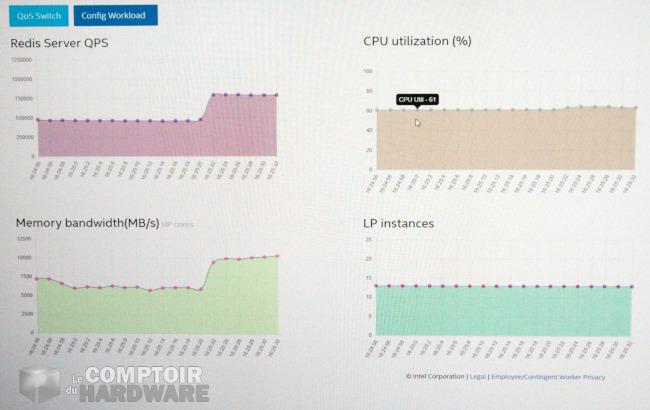

Une autre amélioration apportée par Cascade Lake réside dans la technologie Intel Resource Director Technology. A l'heure actuelle, cette dernière permet aux serveurs virtualisant des OS de partitionner le cache et les accès mémoire afin de prioriser certaines machines virtuelles sur d'autres, en fonction du pourcentage d'occupation de la machine vendue par le fournisseur. Il n'est pas vraiment clair si ces instructions sont présentes ou non sur Skylake-SP, mais des améliorations au niveau de la gestion du débit RAM seront présentes dans cette nouvelle itération sur procédé, avec l'accent sur le maintien d'un débit maximal ou presque lorsqu'une machine effectue un travail intensif seul et qu'une VM de moindre importance vient perturber le travail au moyen de tâches annexes.

Une fois la technologie RDT activée, la bande passante mémoire monte, tout comme les performances du benchmark principal. Impossible de le voir sur cette image, mais le niveau atteint et peu ou prou le même que sans la présence des VM de perturbation.

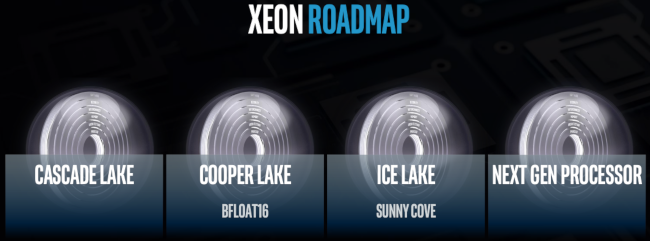

Pour le coup, les plans d'Intel sont clairs : après Cascade Lake, ça sera Cooper Lake, dont la principale amélioration sera le support natif des bfloat16. Ce nouveau type de donnée est utilisé par les adeptes d'apprentissage automatisé pour compacter des réseaux de neurones entraînés sur des variables en 16-bit et ainsi diminuer les ressources nécessaires pour le stockage et l'inférence. Sur les 16 bits disponibles, le bfloat se décompose en 8 bits pour coder l'exposant (comme le flottant 32-bit) et le 7 bits pour la mantisse, accompagné du bit de signe (le résultat étant signe*mantisse*2exposant), contre 5/10/1 pour le flottant classique. Cette structure de données apporte ainsi des valeurs minimales et maximales bien plus grandes (contre un écart minimal inter-valeur, plus grand lui aussi), "ce qui s'avère plus efficace pour les tâches d'IA. Notez que le débit pour ces bfloats sera le double de celui pour les flottants 32 bits, logique quoi !

Ça, c'est net !

Pour Ice Lake, les informations sont plus croustillantes : ce dernier reposera sur la fameuse architecture Sunny Cove qui n'a plus de secret pour vous désormais, signifiant donc une gravure en 10 nm. Intel n'a par contré dévoilé aucune information quant à une possible décomposition en pucelette du bouzin outre le cliché du bébé - un des premiers exemplaires de préproduction arrivé moins de trois semaines auparavant - bien protégé sous son IHS.

Une tête moins connue : Sailesh Kottapalli, du département des solutions architecturales et graphiques, très fier de brandir son Xeon Ice Lake

Notons que si Ice Lake inaugurera (encore) un nouveau socket chez les pros, Cooper Lake aura de la rétrocompatibilité. Nous ne savons pas à l'heure actuelle dans quel sens celle-ci s’opérera, mais nous penchons logiquement vers Skylake-X et Cascade Lake au vu du processus de fabrication restant en 14 nm pour cette famille.

Personne n'a ces ongles au comptoir, nous vous rassurons

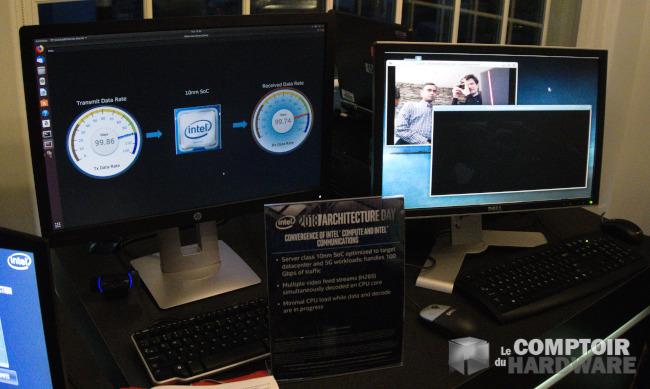

Nouvel OVNI à cette présentation, un SoC (et donc pas un CPU) sans nom, sans fréquence, sans spécification était présent. Qu'est-ce qu'on savait de lui ? Pas grand-chose, si ce n'est qu'il est prévu pour les serveurs, et plus particulièrement ceux de communications à l'ère de la 5G. Le bouzin est présenté comme ayant tout plein de cœurs - sans pour autant rentrer dans la catégorie des CPU scalables vus précédemment - mais surtout est un SoC et non un CPU. Cela signifie qu'il embarque un bon tas d'unités autres que ses cœurs de calcul, notamment pour des tâches de routage (réseau) et de sécurité internet (traitement de calculs liés au protocole IPsec). Les nouvelles à son sujet devraient arriver "rapidement", reste à voir ce que cela signifie dans la pratique. Pour finir de nous mettre l'eau à la bouche, le bouzin est en 10 nm et capable de totalement déléguer ses tâches à chacun de ses accélérateurs dédiés afin de conserver une capacité de calcul disponible au niveau des cœurs CPU quelle que soit la charge réseau.

Routage, affichage vidéo en direct et lecture de film, tout ça en parallèle sur ce même SoC mystère

Deux mots rapides également concernant les Xéons Phi : totalement absents. Après l'annonce de la fin de distribution des séries en juillet 2018, Intel ne semble pas vouloir ressortir le manycore, ou du moins pas aux yeux de tous et pas de sitôt.

Sans trop rentrer dans les détails, Intel a également présenté OneAPI, un framework permettant à terme de faire tourner un même code sur les différentes architectures proposées par Intel (CPU, GPU, FPGA, accélérateur pour l'IA). Si l'idée est bonne, on craint que cela pêche dans l'implémentation, chaque produit ayant ses capacités propres le rendant plus ou moins bien adapté selon la tâche.

![La magie de la loupe, sans loupe one api t [cliquer pour agrandir]](/images/stories/articles/cpu/intel-architectural-day-2018/one-api_t.png)

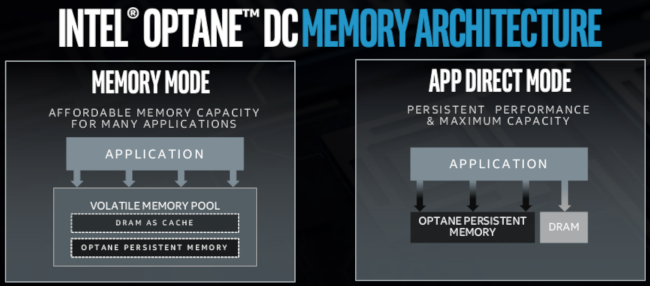

Ici aussi, rien de bien neuf. Mis à part l'insistance sur une solution "abordable" de la solution à base de 3DXPoint (ce qui est la seule indication que les ingénieurs ont eu le droit de donner), mystère-mystère concernant la tarification. Intel confirme cependant que les fameuses barrettes Optane DC sont encastrables dans n'importe quel slot RAM des 12 canaux supportés par Cascade Lake, mais il est néanmoins nécessaire d'avoir à minima une barrette de DRAM traditionnelle pour pouvoir démarrer le système.

La mémoire Optane DC sera configurable selon deux modes : le premier laissera l'OS gérer le partitionnement DRAM / Optane, la première jouant le rôle de cache pour la seconde selon une politique fixe ; ou un second mode montrant ouvertement la hiérarchie DRAM + Optane à l'application. Reste à voir les gains apportés par cette flexibilité, et si le jeu d'optimiser pour Optane à la place d'une politique générique en vaut la chandelle niveau performance.

Pour ceux qui ont leur vie privée à cœur, Intel s'est posé la question de la persistance des données normalement en RAM après extinction de la machine et a réglé le problème, la solution technique demeurant par contre du domaine du secret industriel.

![Visionner en grand sur un magnifique pop-up Allons coloniser la mémoire avec Intel ! [cliquer pour agrandir]](/images/stories/articles/cpu/intel-architectural-day-2018/optane-pyramide_t.png)

Avec un portfolio de plus en plus grand pour ce qui est des solutions de stockage, Intel remplit toutes les possibilités entre un disque dur et de la DRAM classique

|

|

| Un poil avant ?Quel ventirad pour 32 coeurs sur TR4 ? | Un peu plus tard ...Creative Sound BlasterX AE-9 : une carte son pour vous faire roucouler |  |

| 1 • Préambule |

| 2 • Cé Pé Hu : Viva Sunny Cove ! |

| 3 • Gé Pé Hu : Xe et Gen11 |

| 4 • |

| 5 • IA : des solutions logicielles |

| 6 • FPGA : 10 nm également |

| 7 • Conclusion |